隐私保护与离线智能需求日益增长的背景下,OpenClaw本地部署成为越来越多开发者与普通用户的选择。相比云端模型,本地运行具备数据可控、响应稳定、无需网络依赖等优势。本文将以通俗方式介绍OpenClaw的基础部署流程,实现智能对话系统的一键搭建,即使没有技术基础也可以顺利完成。

一、环境准备

OpenClaw对运行环境要求并不复杂,一台具备常规CPU的电脑即可运行,若配备GPU可获得更高性能。建议系统为Windows10/11或主流Linux发行版,并提前安装Python运行环境与必要依赖库。对于完全新手,使用打包好的运行环境会更加便捷,可避免手动配置依赖冲突问题。

二、获取OpenClaw程序与模型文件

通常包含核心运行文件、模型权重以及配置文件三个部分。

下载完成后,将文件放置于统一目录,并通过命令行启动服务程序。成功运行后,本地端口将提供访问接口,意味着基础部署已完成。

三、模型加载与参数配置

用户可根据硬件性能调整推理参数,例如上下文长度、线程数量和缓存策略。合理配置能够在性能与响应速度之间取得平衡。初次使用建议采用默认参数,确保系统稳定运行后再逐步优化。

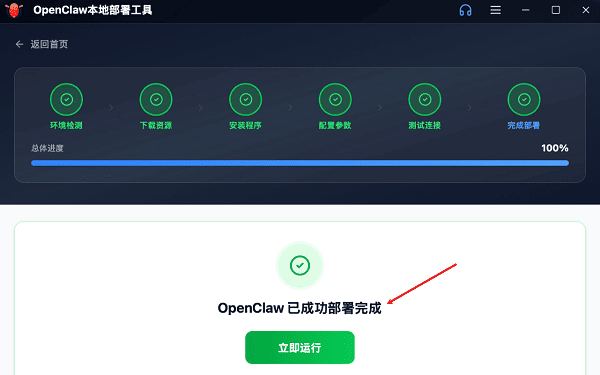

对于希望直接体验智能对话功能的用户,可以使用“OpenClaw部署助手”工具进行自动化部署。该工具通过图形界面整合模型加载、环境检测与服务启动流程,大幅降低操作门槛。小白用户只需要点击下载安装,即可生成本地对话界面,实现类似在线AI助手的交互体验。

好评率97%

好评率97%  下载次数:3175186

下载次数:3175186 1、点击上方下载按钮安装打开“OpenClaw部署助手”选择“点击立即部署”,然后软件便会自动开始安装部署环境;

2、全部安装完成之后,点击“立即运行”;

3、在AI模型界面选择对应的模型输入“API Key”便可以开始使用了。(软件页面有详细的操作步骤指导)

4、点击“首页”选择“打开聊天”便可以开始你的本地部署工作了。

OpenClaw部署助手其优势在于无需手动编写命令或编辑配置文件,同时提供运行状态监控与性能调优建议,非常适合初学者。

四、常见问题处理

如果程序无法启动,多数情况与环境变量或端口占用有关;若响应较慢,可尝试降低模型精度或减少上下文长度。保持模型文件路径规范、避免中文目录名,也能减少运行异常。

总体而言,OpenClaw本地部署并不复杂,借助OpenClaw部署助手工具更可实现“可视化+自动化”的部署体验。通过本文步骤,普通用户即可在本地搭建稳定、安全的智能对话环境,为后续AI应用开发打下基础。