近期 OpenClaw 在技术圈火了起来。它的开源性、可本地运行的特点吸引了大量用户关注:尤其是希望本地跑大模型、保护隐私、减少云端成本的开发者和爱好者。

但真正开始尝试的朋友会发现一个现实难题:明明听说它可以本地跑,为什么我的电脑跑不起来?今天我们将从真实配置需求、常见失败原因分析入手,让普通电脑也能轻松体验本地 OpenClaw。

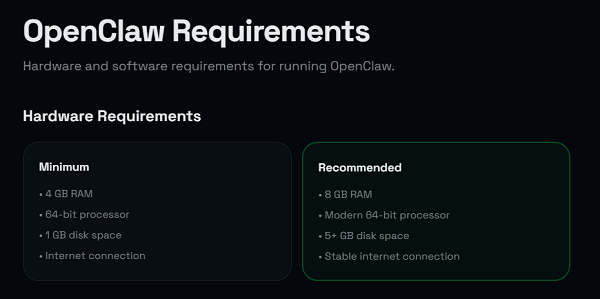

一、OpenClaw本地运行需要什么配置?

OpenClaw 属于本地推理框架,本质上是让模型在你自己的电脑上以“推理(Inference)”方式运行。这个过程会消耗显存、内存和一定 CPU 资源。

有关配置需求的判断,有不少公开社区实测、推理框架说明和模型显存占用测算说明可以佐证,比如 Hugging Face、PyTorch、TensorRT 的显存占用说明,以及 GitHub、discussion 社区中的大量用户反馈。这些反馈的结论是:

1、显存越小:只能运行参数更小的模型或需开启精简模式;

2、显卡有 CUDA 支持:整体效率显著更高;

3、纯 CPU 模式:可运行但响应较慢;

4、系统内存建议 ≥ 16GB:避免频繁换页影响性能。

图源:OpenClaw Center

二、为什么很多人“理论能跑”却部署失败?

很多人之所以卡在部署阶段,并不是因为显卡不够,而是部署过程复杂、环境配置繁琐。核心原因是:

1、需要安装正确版本的 Python;

2、需要 CUDA 与驱动版本完美匹配;

3、环境依赖库繁多且容易冲突;

4、模型下载手动进行,速度慢且易断;

5、各种版本组合错配导致报错。

这并非硬件本身无法支持,而是“如何配置环境”成了门槛。对于普通用户来说,即便配置足够好,只要在安装依赖或 CUDA 匹配上出错,就可能无法启动模型。

三、一键部署OpenClaw

为了破解这个部署难题,我们推荐使用OpenClaw部署助手。这是一款专注于本地AI模型部署的辅助工具。它能:

1、自动识别显卡型号、CUDA 版本;

2、自动完成适配模型版本的推理环境;

3、一键执行模型下载、环境配置;

4、自动启动模型服务,无需命令行操作。

也就是说,它把技术难题从“技术门槛”变成了“点鼠标操作”。

四、使用OpenClaw部署助手部署OpenClaw模型

第一步:下载安装OpenClaw部署助手

在电脑上下载并安装OpenClaw部署助手。打开后界面会自动识别你的硬件信息,包括显卡、CPU 和可用显存。

好评率97%

好评率97%  下载次数:3308811

下载次数:3308811 第二步:开始部署

下载完成后点击“立即部署”

① 模型所需显存

② 系统内存要求

③ 适合的硬件等级

只需点击对应版本右侧的“启动”或右下角的“立即启动”。

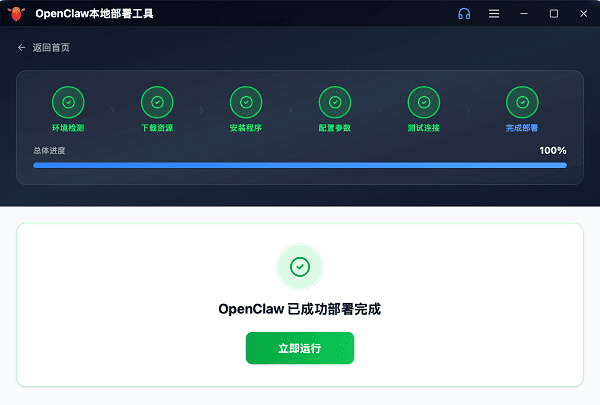

第三步:自动完成部署

此时软件会自动:

① 检测环境

② 下载资源

③ 安装程序

④ 配置参数

无需你手动写命令或配置Python环境就可以完成部署。

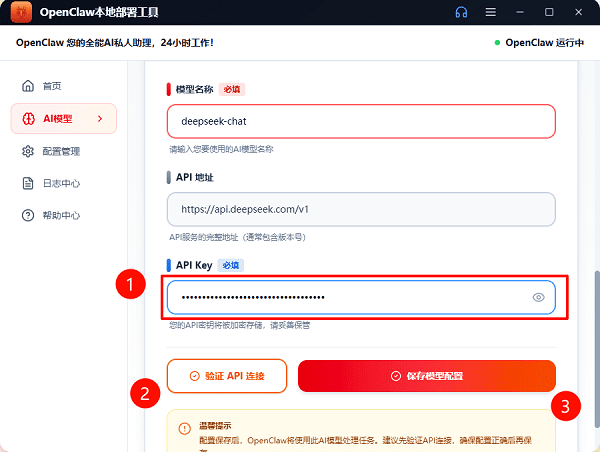

第四步:启动模型并进入对话

部署完成后进入对话界面。

在上方选择所需的AI模型,并在下方输入API Key即可开始互动。

整个流程从选择→安装→启动只需几分钟。

通过OpenClaw部署助手,能够在普通显卡(如 8GB 级别)上成功运行 OpenClaw 模型,响应速度稳定、启动成功率高。显卡显存较低时(如 4GB)可选择小参数版本,也能运行,只不过交互略慢。CPU 模式虽然能启动,但建议有显卡时优先启用 GPU,以获得更流畅体验。

五、常见问题解答

Q:没有独显也能运行吗?

能,通过 CPU 模式可以运行,但速度较慢。

Q:显存不够会出错吗?

会,但选择低参数模型或开启显存优化模式可解决。

Q:需要手动安装 CUDA 吗?

不需要,OpenClaw部署助手会自动判断并提示。

总体来看,普通电脑是可以运行 OpenClaw 的,只要正确匹配模型和部署环境即可。真正难的是部署环境,而不是模型本身。借助“OpenClaw部署助手”这类辅助工具,可以快速完成模型部署,把精力放在实际使用上。只要硬件满足基本条件,普通电脑同样可以体验本地AI的乐趣!

最新资讯

Claude Opus 4.8版本发布:提升AI编程可靠性,减少无依据结论

Claude Opus 4.8版本发布:提升AI编程可靠性,减少无依据结论5月29日,Anthropic正式推出Claude Opus 4.8。价格与上一代保持一致,重点改进集中在编程能力、智能体任务、推理准确性和知识工作几个方向。

2026-05-29 12:37:40lucky15411 OpenClaw和豆包的区别:一个帮你干活,一个给你答案

OpenClaw和豆包的区别:一个帮你干活,一个给你答案OpenClaw和豆包是两种经常被混淆的AI工具——前者是开源AI Agent框架,后者是云端大模型应用。本文详细拆解两者的本质差异,并介绍OpenClaw部署助手如何降低本地部署门槛,帮助用户按真实需求精准选择。

2026-05-28 18:53:00Portia26612 英伟达发布610.47驱动:支持《007:初露锋芒》,NVIDIA控制面板正式退役

英伟达发布610.47驱动:支持《007:初露锋芒》,NVIDIA控制面板正式退役英伟达正式发布GeForce Game Ready 610.47驱动,为《007 First Light》提供首发优化,支持DLSS 4.5超分辨率和动态多帧生成技术。同时该驱动还新增对《乐高蝙蝠侠:黑暗骑士遗产》《EA SPORTS F1 25 2026赛季包》《坦克世界:HEAT》的DLSS支持,并修复了《如龙8》《雾锁王国》等游戏的画面闪烁和地形缺失问题。更值得关注的是,服役20年的NVIDIA控制面板正式退役,全部功能迁移至NVIDIA App。

2026-05-28 17:05:12Portia20169