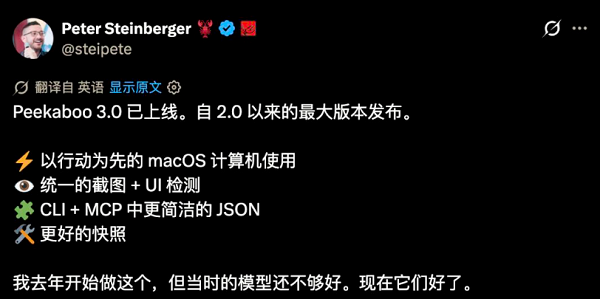

近期发布的OpenClaw Peekaboo v3,本质上是一套“AI视觉感知”能力扩展,它能够让OpenClaw自动识别电脑屏幕内容、读取应用界面、分析截图,并结合AI模型完成自动化操作。相比传统只能依赖文本输入的AI Agent,Peekaboo v3最大的变化,是让AI开始具备“视觉理解能力”。

根据最新GitHub项目说明,目前Peekaboo已支持macOS CLI与MCP Server模式,可用于截图分析、界面识别以及视觉问答等场景。

一、OpenClaw Peekaboo v3是什么?

从目前社区讨论来看,Peekaboo v3 更像是 OpenClaw AI Agent 的“眼睛”。简单来说,以前很多 AI Agent:

只能读取文本

无法真正理解GUI界面

看不到软件窗口内容

无法判断按钮位置

而 Peekaboo v3 的出现,相当于让 AI:

能截图

能读取当前屏幕

能分析应用界面

能结合视觉模型进行判断

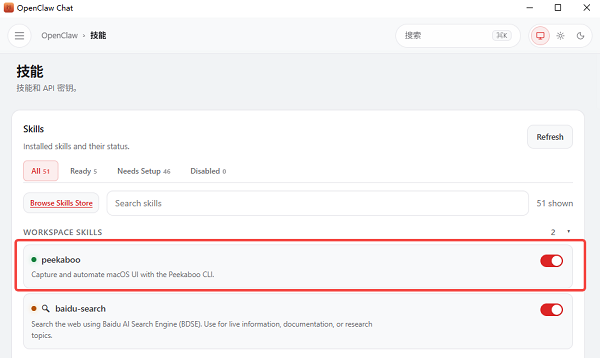

图源:36氪

GitHub 项目描述中提到,Peekaboo 可以让 AI Agent 捕获整个系统或指定应用截图,并支持通过本地或远程 AI 模型进行视觉问答。这也是为什么最近很多开发者开始把它称为:“OpenClaw视觉层”。

二、Peekaboo v3的核心能力有哪些?

1、AI屏幕识别

这是 Peekaboo 最核心的功能。AI 可以:

读取当前屏幕内容

识别按钮

判断窗口状态

分析软件界面

相比传统 OCR,它更偏向“视觉理解”。

图源:GitHub

2、截图分析

Peekaboo 可以直接对系统截图进行处理。例如:

分析网页内容

判断错误提示

理解UI布局

自动提取关键信息

目前很多 OpenClaw 用户已经开始拿它做网页自动化与信息筛选。

3、MCP Server 接入

Peekaboo v3 还支持 MCP Server 模式。这意味着它不仅能单独运行,还能接入:

OpenClaw

第三方Agent

自动化工作流

GitHub 项目中也明确提到 Peekaboo 支持 CLI 与 MCP Server 两种运行方式。

4、结合视觉模型理解界面

现在很多 AI 模型已经支持视觉能力,比如:

GPT-5 系列

Gemini 3.1

Claude Vision

Qwen VL

而 Peekaboo v3 相当于负责“看屏幕”,模型负责“理解内容”。OpenClaw 近期版本也持续增强多模型生态支持,包括 Gemini 3.1、Moonshot/Kimi 等。

三、为什么很多人会搭配OpenClaw使用?

实际上,Peekaboo更像:“视觉插件”。真正让它发挥作用的,还是OpenClaw Agent、Skill系统、大模型能力。但问题在于很多普通用户其实不会部署OpenClaw,尤其是Peekaboo v3这种涉及视觉能力与MCP的功能,如果完全手动配置,对新手门槛其实不低。相比传统命令行部署,使用【OpenClaw部署助手】能够把原本复杂的AI Agent环境配置做成可视化流程。操作步骤:

1、先下载安装 OpenClaw部署助手。

好评率97%

好评率97%  下载次数:3249041

下载次数:3249041

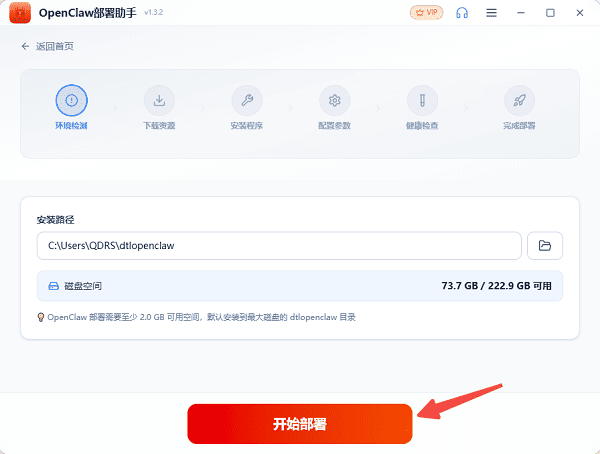

2、打开软件后,点击“开始部署”,帮完成基础环境初始化,无需写任何代码。

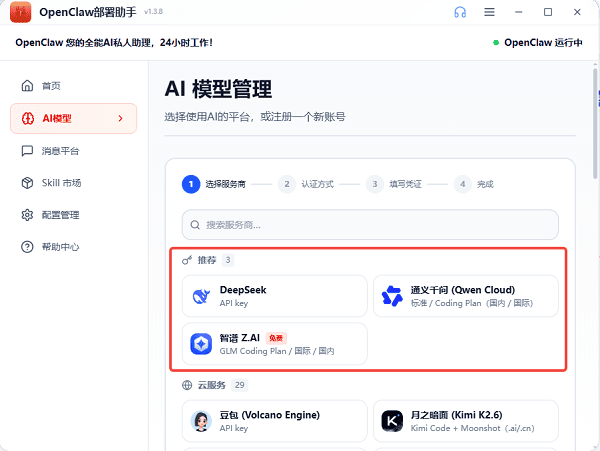

3、部署完成后,需要配置大模型(如果想体验 Peekaboo v3,建议优先选择支持视觉能力的模型)。

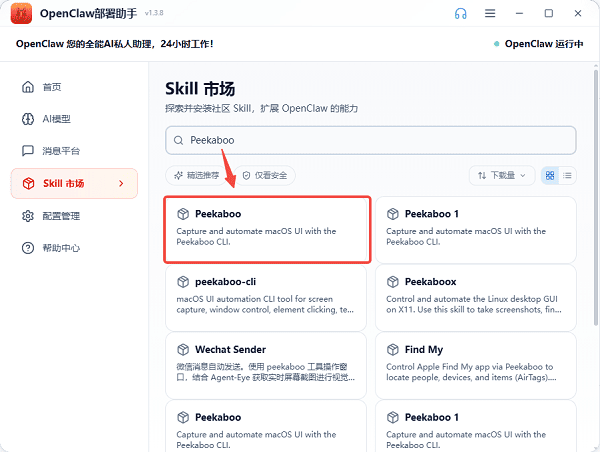

4、接着我们需要安装Peekaboo相关Skill,进入左侧“Skill市场”,搜索Peekaboo、MCP或Vision。

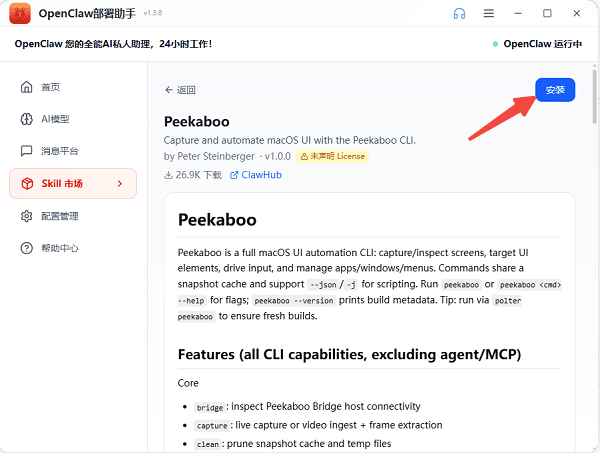

5、点击后可查看详细信息,并安装对应Skill,这样OpenClaw才能调用视觉能力。

6、安装完成后,打开聊天界面,在“技能”界面查看是否启用Peekaboo MCP。

7、启用后,AI 就能读取当前屏幕、应用窗口以及截图内容。

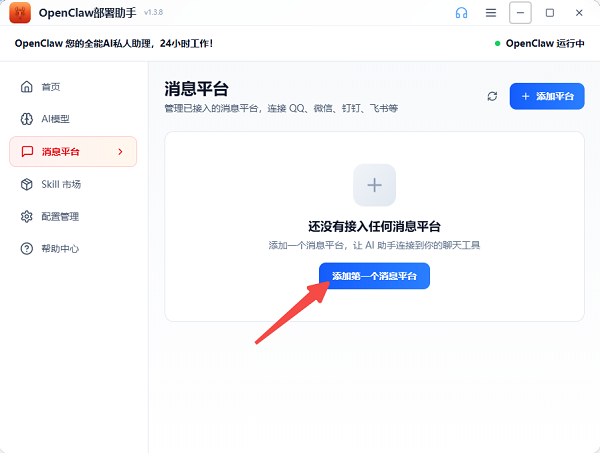

8、如果想远程调用 Agent,还可以继续接入QQ机器人、微信、飞书等,这样就能远程触发视觉任务。

四、Peekaboo v3目前适合的场景

| 使用场景 | 具体用途 |

| AI网页操作 | 自动分析网页内容 |

| AI桌面助手 | 自动识别窗口与按钮 |

| 自动化办公 | 自动处理重复操作 |

| 软件测试 | 自动识别异常界面 |

| 数据采集 | 自动抓取页面信息 |

| 多Agent协作 | 结合视觉完成任务链 |

目前 OpenClaw 社区中,“AI桌面助手”与“自动化工作流”是最热门方向之一。

Peekaboo v3 的真正意义,其实并不只是“截图工具”,而是让 OpenClaw 开始真正具备“看懂电脑界面”的能力。对于普通用户来说,如果不想花大量时间研究部署和配置流程,借助像“OpenClaw部署助手”这类可视化工具,其实会更容易快速体验到Peekaboo v3和OpenClaw的完整能力。