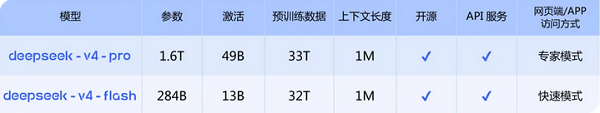

DeepSeek正式推出V4预览版本,引发AI圈广泛关注。此次DeepSeek V4在架构上采用了更高效的MoE(混合专家)机制,并支持最高百万Token上下文窗口,在长文本处理与推理能力上实现显著提升 。

与此同时,一个更现实的问题也被大量用户关注:DeepSeek V4这么强,我的低配置电脑还能本地运行吗?答案是:可以,但要“分版本+选策略”。

一、DeepSeek V4的核心变化:为什么更吃配置但更灵活?

相比上一代模型,V4有两个关键升级:

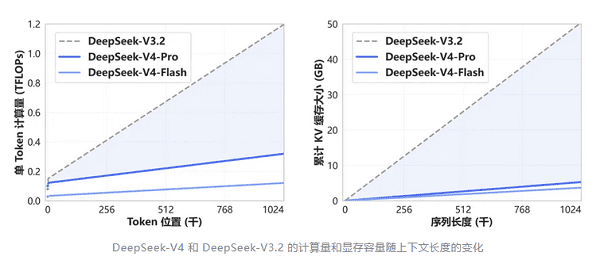

1、超长上下文能力(1M Token)

可以一次性处理整本书、超长代码库或复杂多轮对话,大幅提升AI记忆能力 。

图源:DeepSeek

2、MoE架构降低运行负担

V4总参数达到1.6万亿,但实际推理仅激活部分参数(Flash约13B级别激活),显著降低计算压力 。

总结来看就是:“模型很大”,但“实际运行没那么重”。

二、低配置设备能不能跑?关键看这三点

本地运行DeepSeek V4,不是单纯看电脑强不强,而是看三大条件:

1、模型版本选择(决定能否运行)

V4-Pro:企业级(低配基本不可能)

V4-Flash:轻量推理版本(关键选择)

图源:DeepSeek

2、是否量化(决定显存需求)

FP16:高精度,高负载

INT8/INT4量化:低显存可运行

3、推理方式

GPU推理(推荐)

CPU推理(可用但较慢)

三、不同配置设备的运行能力对照表

| 设备级别 | 可运行版本 | 是否流畅 | 适用场景 |

| 旧笔记本(16GB内存) | V4-Flash(CPU+量化) | 勉强可用 | 简单问答 |

| 普通游戏本(RTX 3060) | V4-Flash | 基本流畅 | 写作/代码 |

| 中端主机(RTX 4060/4070) | V4-Flash + 高量化 | 流畅 | AI办公 |

| 高端主机(RTX 4090) | V4-Pro(部分能力) | 很流畅 | 专业开发 |

| 服务器级 | V4-Pro全量 | 完整性能 | 企业级应用 |

四、低配置设备本地运行的核心思路

想让老电脑跑DeepSeek V4,本质不是“硬刚性能”,而是:

思路1:降低模型体积

使用 V4-Flash + INT4量化(显存需求从“几百GB”降到“几十GB级别”)

思路2:降低推理压力

限制上下文长度(例如8K~32K)

思路3:本地+分层运行

简单任务本地

复杂任务调用更高性能模型

五、关键工具:DeepSeek本地部署大师

对于大多数用户来说,真正的难点不是“模型能不能跑”,而是:

① 环境配置复杂(CUDA / Python / 依赖库)

② 模型下载与路径配置

③ 量化参数难以理解

④ GPU识别失败

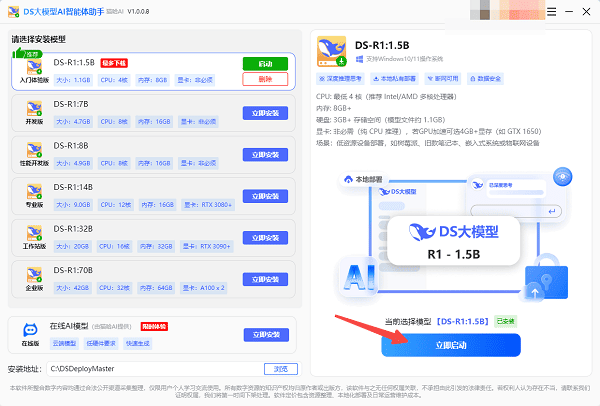

不用担心,这些问题【DeepSeek本地部署大师】统统帮你搞定!只需完成三步:

第一步:下载并安装DeepSeek本地部署大师

点击下方按钮直接获取“DeepSeek本地部署大师”安装包。安装过程全程自动,无需额外配置。

好评率97%

好评率97%  下载次数:3208649

下载次数:3208649 第二步:选择适合你显卡的量化版本并一键安装

打开软件,在模型列表中可以看到V4的不同量化版本。

软件会根据你的GPU显存自动推荐合适的版本——从适合高端显卡的版本到适中的量化版本,一应俱全。

点击“立即安装”按钮,软件会自动下载模型、配置环境。

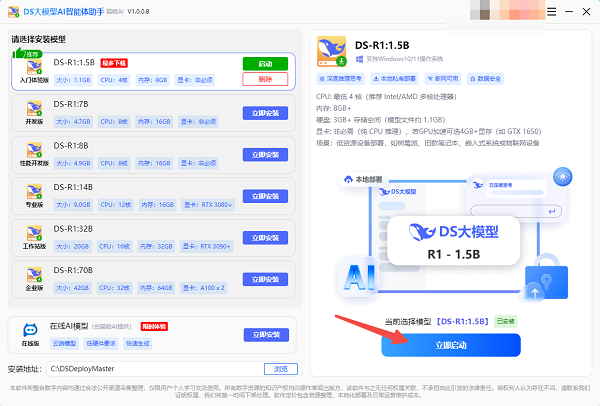

第三步:启动模型,开启你的本地AI体验

部署完成后,即可在软件内直接与V4对话,或通过API接口将模型接入你的其他应用。

选择本地部署的另一个隐性优势是经济账:如果你每天频繁调用API,日积月累下来,token费用并不低。相比之下,一次性部署V4模型后用本地大师就能无限次使用,长期来看是更为实惠的选择。

六、常见问题

Q1:4GB显卡能跑DeepSeek V4吗?

可以,但只能使用CPU或极低量化版本,体验较慢。

Q2:没有独显可以运行吗?

可以,通过CPU推理,但速度有限。

Q3:V4和V3最大的区别是什么?

V4支持百万Token上下文,并优化MoE推理效率。

DeepSeek V4的发布标志着一个趋势:AI不再只是“高配设备专属”,而是逐步走向“分层可用”。通过Flash轻量模型、INT4量化、本地推理优化,即使是普通电脑,也能参与AI应用生态。而借助DeepSeek本地部署大师这样的工具,原本复杂的本地部署过程被极大简化,让低配置设备也能真正“跑起来AI”。