DeepSeek正式发布了V4预览版,旗下两条产品线同步开源——V4-Pro和V4-Flash,凭借百万级上下文容量和极高的性价比,立刻刷爆了整个科技圈。

最关键的是,因为是MIT协议全开源,任何人都可以自由下载,部署到本地,数据不用上传,隐私彻底掌握在自己手里。今天就手把手教你,怎么在自己的电脑上把DeepSeek V4跑起来。

一、先弄清楚:你该部署哪个版本?

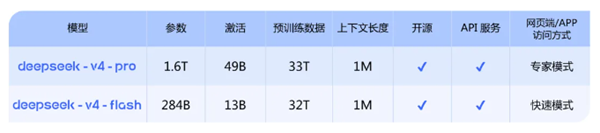

在开干之前,先搞清楚你要部署的是V4-Pro,还是V4-Flash。

DeepSeek V4-Pro: 旗舰款,1.6万亿参数,实际激活的也有490亿。适合写复杂代码、做深度分析、处理超长文本。当然,对硬件要求也高得多。

DeepSeek V4-Flash: 轻量款,2840亿参数,激活130亿。日常写文案、聊天、轻办公完全够用,响应也快。

(图源:DeepSeek)

此外,V4的百万级超长上下文,所有官方服务都默认支持。这在以前只有顶级闭源模型才敢这么玩。

对于大多数中小企业和个人用户,更推荐V4-Flash,性价比和实用性更加均衡。

二、硬件门槛:你的电脑扛得住吗?

本地跑大模型,最大的坎永远是显存和显卡。V4虽然优化得不错,但硬件还是有基本要求的。给你几个参考配置:

官方满血版(FP16精度)

V4-Pro:至少8张H100 80G,总显存需求约1.6TB。

V4-Flash:8张A100 40G,或者2张H100。

高性价比方案(FP4/FP8混合精度)

V4-Pro:需要约400G显存,可以8张RTX 3060或者华为Atlas 350搞定。

V4-Flash:需要160G显存,4-6张RTX 4090就行。

极限压缩版(Q2精度,有精度损失)

V4-Flash最低可以压到90G显存,2-3张RTX 3090就能跑。

另外提醒一下,如果你要用百万级的长上下文,KV缓存会额外吃掉20-30G显存,记得预留空间。

看到这里你可能已经发现了:这些配置,90%的人都扛不住。一张H100能买一辆车,普通玩家根本玩不起。那普通人就没法用了吗?当然不是。下面这套方案,零成本、旧电脑就能跑。

三、通过OpenClaw接入DeepSeek V4

我们换个思路——不在本地跑模型本身,而是在本地搭一个OpenClaw框架,然后调用DeepSeek V4的API接口。体验一模一样,成本几乎为零。

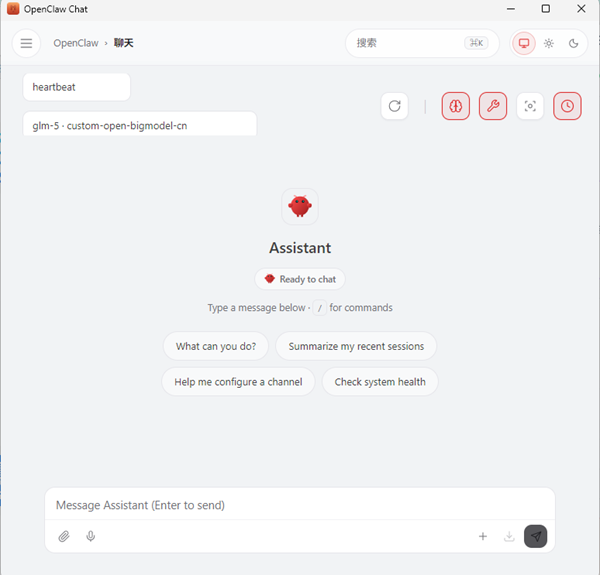

OpenClaw是2026年很火的开源AI智能体框架,它不是只会聊天,还能操作文件、控制浏览器、跨应用干活。DeepSeek V4负责当“大脑”做推理,OpenClaw负责当“手脚”执行任务。

下面是具体步骤,跟着做就行。

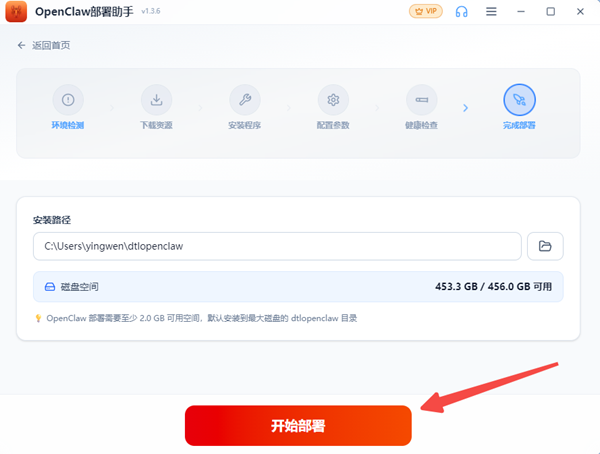

第1步:部署OpenClaw

点击下方按钮,下载“OpenClaw部署助手”。

好评率97%

好评率97%  下载次数:3208649

下载次数:3208649 打开软件后,点击【开始部署】,整个过程全自动,不用敲一行代码。等进度条走完,显示“部署成功”就OK了。

第2步:获取DeepSeek API Key

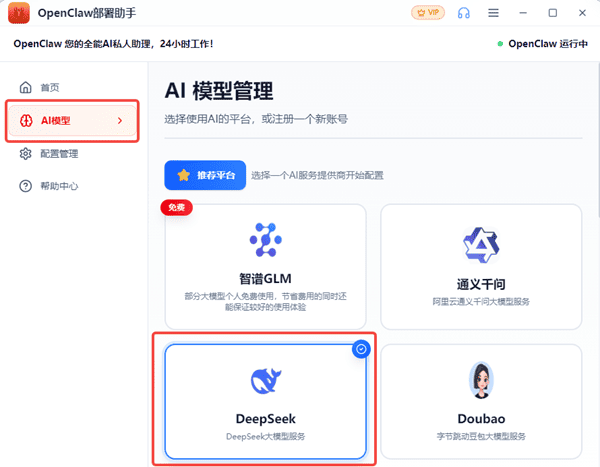

OpenClaw本身不带任何AI模型,你接入什么模型,它就有什么能力。现在我们要接入DeepSeek V4。

在OpenClaw部署助手里点【AI模型】,选择DeepSeek。

然后点它给的链接,去DeepSeek开放平台注册登录。

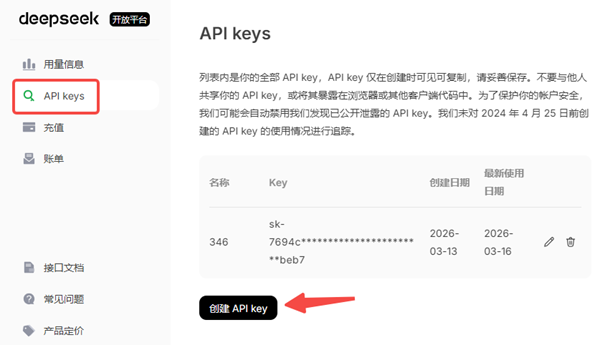

进入“API Keys”页面,点击“创建 API Key”——就是一串以sk-开头的字符,复制下来保存好。

回到软件中,把API Key粘贴进去,点【保存模型配置】。几秒钟后显示“配置成功”就行了。

第3步:开聊

配置保存后,返回助手首页,点【打开聊天】,然后输入你的第一个问题。如果收到了流畅的回复,恭喜你,你的本地AI助手已经上岗了。

满血私有化部署,是给发烧友和土豪准备的。普通用户完全没必要折腾那些昂贵的显卡。用OpenClaw + API的方案,旧电脑就能跑,整个过程花不了十分钟。先按上面的流程走一遍,亲自体验一下DeepSeek V4的真实水平。