在本地部署或使用OpenClaw接入大模型时,不少人都会遇到这样一个报错:LLM request timed out。看起来像是系统“卡死”,其实本质很简单——请求已经发出,但模型在规定时间内没有返回结果,系统直接判定为超时。下面就帮你把常见原因和对应解决思路一次讲清楚。

一、原因分析

1、模型响应时间过长:大模型推理本身就需要时间,如果任务复杂、上下文过长或者涉及多轮调用,很容易超过默认等待时间。

2、网络连接不稳定:调用远程模型时,网络质量直接决定响应速度,一旦延迟高或连接不稳定,就可能导致请求中断或卡住。

3、模型服务端拥堵或限流:在高峰期,热门模型服务端可能出现排队或限流,导致响应明显变慢甚至超时。

4、本地模型或硬件性能不足:如果使用本地模型,设备性能不足或模型未正确运行,也会导致请求长时间没有返回结果。

5、API配置错误或异常:包括API Key错误、接口地址填写错误、模型名称不匹配等,这类问题往往不会直接报错,而是表现为“无响应”。

6、任务并发或队列积压:如果同时运行多个任务或Agent循环调用,请求进入队列后等待时间过长,也会触发超时机制。

二、解决方案

方法一:先检查网络环境

很多人第一步就去改配置,其实最常见的问题反而是网络。尤其是在调用国外API时,网络不稳定几乎是“超时”的头号原因。操作步骤:

1、打开浏览器测试API网站是否能访问。

2、如果使用代理,确认已全局生效。

3、尝试切换网络(如手机热点)。

4、使用命令行工具测试接口连通性。

5、重新运行OpenClaw任务。

方法二:降低请求复杂度

请求越复杂,模型处理时间越长,适当“减负”可以明显降低超时概率,尤其是在调试阶段非常有效。操作步骤:

1、清空或缩短对话历史,降低max_tokens参数。

2、避免一次性输入大段文本,简化Prompt逻辑。

3、重新测试响应时间。

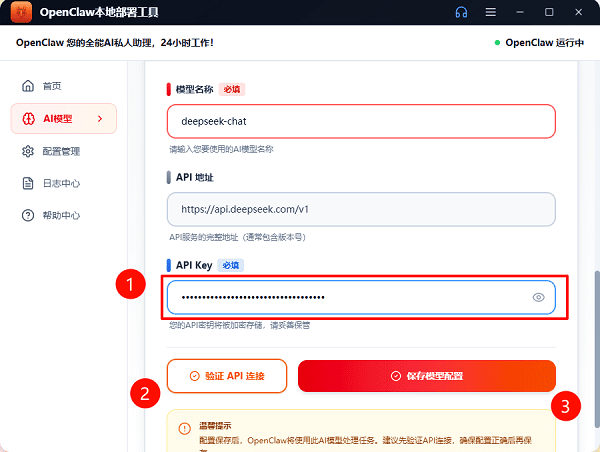

方法三:使用OpenClaw部署助手排查模型与配置问题

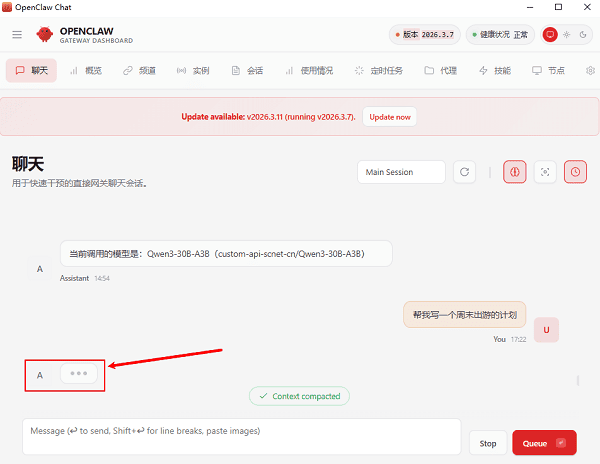

很多“LLM request timed out”并不是真正意义上的“超时”,而是因为模型没接对、API配置错误,或者接口压根没打通,最终表现成一直等待然后超时。这类问题如果靠手动逐项排查,往往又慢又容易漏。

这时候可以借助【OpenClaw部署助手】做一次集中排查+自动修复:它不仅能帮你规范环境配置,还可以顺带完成模型切换测试、接口连通验证,把原本分散的排查步骤一次性跑通,效率会高很多。操作步骤:

好评率97%

好评率97%  下载次数:3091055

下载次数:3091055

1、打开OpenClaw部署助手,进入环境检测模块,一键执行基础环境扫描(依赖、端口、服务状态)。

2、在AI模型配置页面重新选择或切换模型(可用于对比测试)。

3、自动校验API Key、API地址、模型名称是否匹配。

4、执行接口连通性测试,确认请求是否能正常返回。

5、完成后返回OpenClaw重新运行任务进行验证。

方法四:优化本地模型或设备性能

如果使用本地模型,性能瓶颈会直接体现在响应速度上,甚至导致完全无响应。操作步骤:

1、确认模型服务已启动。

2、检查CPU/GPU占用情况,关闭其他高占用程序。

3、尝试加载更小模型,再次测试响应。

方法五:减少并发任务和循环调用

任务越多,排队越长,尤其是Agent自动循环时,很容易触发超时。操作步骤:

1、停止不必要的任务,降低并发数量。

2、减少Agent循环次数。

3、单任务测试稳定性。

常见问题解答(FAQ)

1、偶尔出现超时需要处理吗?

如果只是偶发,通常是网络或服务波动,可以忽略;只有频繁出现才需要排查。

2、用云模型也会和电脑性能有关吗?

基本无关,云模型主要受网络和API影响;只有本地模型才依赖电脑性能。

3、一直超时但没有报错,是哪里的问题?

很大概率是API配置错误或网络未打通,需要重点检查这两项。

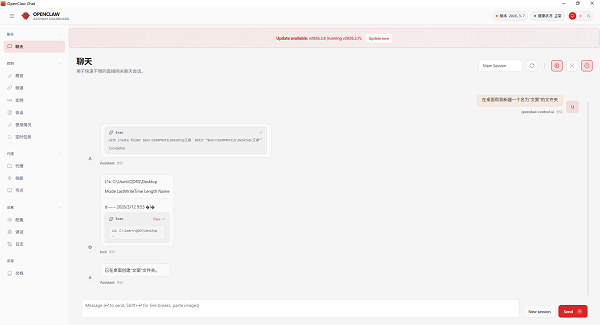

当OpenClaw出现“LLM request timed out”时,建议不要一上来就反复重装,按照本文的方法逐步定位问题,同时在部署阶段借助【OpenClaw部署助手】把基础环境一次性理顺,可以有效减少后续反复踩坑的情况,这样处理下来,大多数超时问题其实都能比较轻松地解决。