如果最近你也忙着“养龙虾”,那么大概率会遇到一个问题:明明只是问一句话,却要等OpenClaw好几秒甚至更久才有回应。有时候还会越用越慢,让人怀疑是不是哪里出问题了。其实,这种“卡顿感”并不是个例,而是很多用户在实际使用中的共同反馈。下面就从实际使用角度,帮你梳理最核心的几个原因,以及对应的解决方法。

一、减少不必要的任务链和工具调用

OpenClaw本质不是一个简单的聊天工具,而是一个“自动执行系统”。一次请求通常会经历:任务理解 → 规划 → 工具调用 → 再推理 → 输出结果。也就是说,你看到的一次回答,背后可能已经跑了好几轮模型调用。操作步骤:

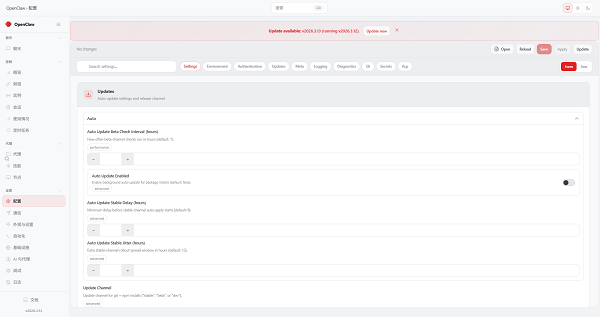

1、打开 OpenClaw 设置界面,找到「Agent模式」或「自动执行策略」。

2、关闭或降低以下功能:

自动工具调用(Tool use)

多步任务拆解(Plan模式)

3、优先选择“简化模式 / 单轮对话模式”。

4、保存后重新测试响应速度。

二、限制上下文长度

OpenClaw默认会“记住很多内容”,包括历史对话、工具返回结果等。当上下文越来越长时,模型每次计算都会变慢。操作步骤:

1、进入 OpenClaw 配置页面。

2、找到「Context Length / 上下文长度」设置。

3、将默认值调整为:推荐(2048 或 4096)。

4、开启「自动清理历史记录」或手动清空对话。

5、重新发起新对话测试速度。

三、优化模型或部署方式

很多用户使用本地模型,但设备配置有限,比如:没有GPU、显存不足、使用未优化模型,这会直接导致生成速度非常慢(甚至每秒只有几token)。这里可以借助【OpenClaw部署助手】来降低门槛,它支持一键本地部署环境,能够快速切换模型,避免手动踩坑,尤其适合新手。操作步骤:

1、点击下方下载按钮,安装并打开「OpenClaw部署助手」。

好评率97%

好评率97%  下载次数:3231542

下载次数:3231542

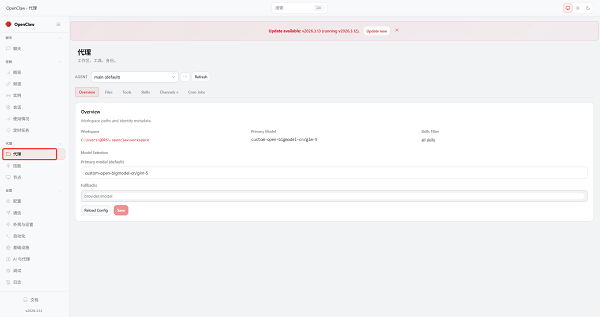

2、进入“AI模型”模块,选择适合自己电脑配置的模型,例如:智谱GLM、通义千问、DeepSeek等。

3、选择完成后需要输入对应的API Key才能正常使用。【API Key获取教程】

4、输入后依次点击“验证API连接”和“保存模型配置”,等待配置完成即可。

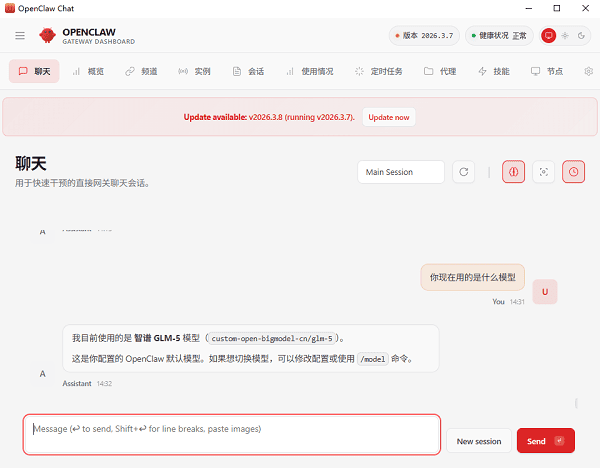

5、最后回到首页,点击“打开聊天”即可进行正常聊天了。

四、优化网络或减少远程调用

如果你使用的是云端模型(如API调用),那每一步Agent操作都需要联网请求。一旦网络波动,就会被放大成明显卡顿。操作步骤:

1、检查当前网络是否稳定(建议使用有线网络)。

2、尽量避免高峰期使用。

3、在设置中关闭不必要的外部API调用,减少工具依赖。

4、如果条件允许,优先切换为本地模型运行。

五、简化输入指令

OpenClaw的强项是复杂任务自动执行,但如果只是简单问题,却触发复杂流程,就会显得很慢。操作步骤:

1、尽量明确任务目标,避免使用过于复杂的描述。例如:

❌ “帮我分析并优化这个方案并给建议”

✅ “帮我总结这段内容”

2、关闭“自动规划任务”功能。

3、优先使用直接问答模式。

常见问题解答(FAQ)

1、为什么刚开始快,越用越慢?

通常是上下文累积导致,清空对话即可恢复。

2、本地模型一定比API快吗?

不一定,低配置电脑反而更慢。

3、必须用高配置显卡吗?

不必须,但会显著影响速度体验。

整体来看,OpenClaw“慢”并不是单一故障,而是其Agent架构 + 多轮推理 + 上下文机制共同作用的结果。但好消息是,大多数情况下都可以通过以上几种方法来提升响应速度。如果你不想折腾复杂配置,也可以借助像【OpenClaw部署助手】这样的工具,快速完成环境和模型优化,让整体体验更顺畅!