想玩DeepSeek V4,却被动辄几十万的硬件配置劝退?这篇就是为你准备的“省钱通关指南”。我们直接把硬件方案砍到最简:个人用户一张RTX 4090就够了。搭配DeepSeek V4+OpenClaw黄金组合,低配置电脑也能立马跑起来!

一、DeepSeek V4双版本介绍

DeepSeek-V4-Pro(旗舰版):1.6万亿总参数,单次激活490亿参数,适用高精度推理与复杂Agent任务。

DeepSeek-V4-Flash(轻量版):2840亿总参数,单次激活130亿参数,适合追求性价比的用户。

全系标配100万Token超长上下文,处理《三体》三部曲这样的海量文本毫无压力。MIT许可开源,支持英伟达与华为昇腾双平台。

二、DeepSeek V4部署硬件配置要求

MoE架构模型需要加载全部参数至显存,不同精度下显存需求如下:

| 精度 | V4-Pro显存 | V4-Flash显存 | 适合场景 |

| FP4/INT4(推荐) | 约400GB | 约160GB | 高性价比生产环境 |

| Q2/INT2(入门) | 约200GB | 约90GB | 个人研发测试 |

核心配置方案(极简版):

个人/开发者:单张RTX 4090 24GB + AWQ量化版V4-Flash,约5000-8000元即可跑起来。

中小企业:2×H100 80GB 或 2×3090,约30-60万元。

企业级集群:16×H100或华为Atlas 350,预算百万级。

关键提示:量化技术+框架优化(vLLM)可让显存需求减半,吞吐性能提升3倍。配NVMe SSD是底线,机械硬盘跑不动。

三、普通电脑部署方案

本地部署V4对普通人来说完全没有性价比。你花几万块钱配的电脑,跑出来的效果还不如免费网页版——因为网页版背后是上千张H100集群。

如果你想体验V4的智能体能力(如自动执行任务、操作浏览器等),推荐使用DeepSeek V4 + OpenClaw这样的黄金组合——本地无需部署大模型,只需运行轻量框架,通过API调用云端 V4,既省硬件又能实现自动化。

目前,OpenClaw已将DeepSeek V4设为默认模型。下面教大家通过 「OpenClaw 部署助手」 快速配置并接入DeepSeek V4:

①点击下方按钮,下载并安装OpenClaw部署助手;

好评率97%

好评率97%  下载次数:3213713

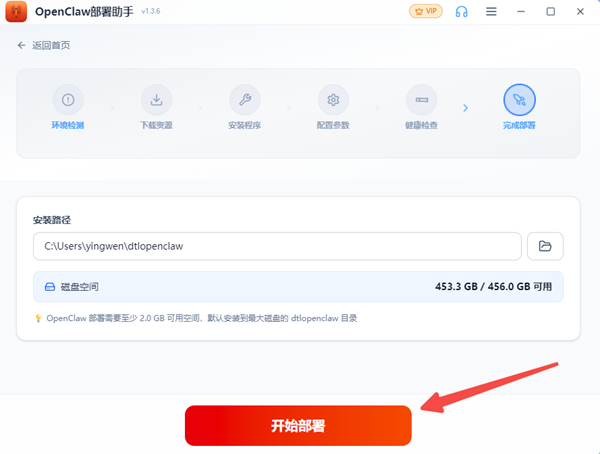

下载次数:3213713 ②打开软件,点击【开始部署】,部署助手自动完成环境检测、Python安装、依赖下载;在配置参数的过程中,可以先点击【确认配置并继续】。

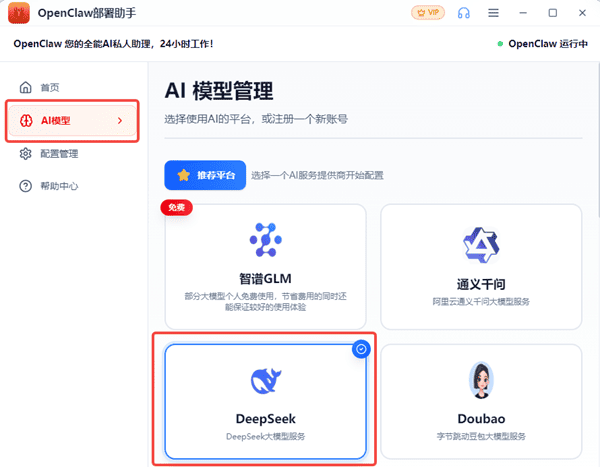

③部署完成后点击【AI模型】,从模型列表中选择DeepSeek;

④点击对应链接,前往DeepSeek开放平台,注册并获取API Key(一般以 sk- 开头)。

⑤复制Key粘贴到软件对应的位置中,并填入正确的模型名称,点击【保存模型配置】。

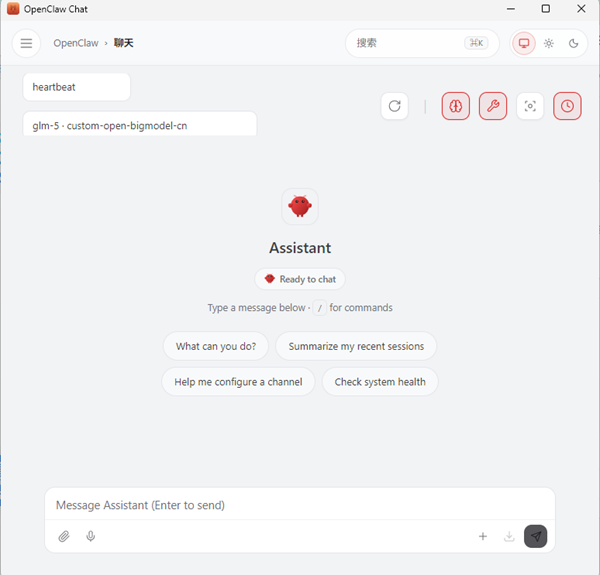

⑥返回首页,点击【打开聊天】,跳转到OpenClaw窗口。发送一条消息,若能正常收到回复,说明部署成功——你的专属AI数字员工就上线啦!

如果觉得这篇文章对你有用,转发给正在苦恼部署和硬件配置的朋友,一起在DeepSeek-V4的时代快人一步!