OpenClaw因其轻量化与可扩展特性逐渐受到大家关注,且近期的热度居高不下。本文将从环境准备、依赖安装、程序运行与常见问题排查四个层面,提供一套可复现的OpenClaw安装流程,实现智能对话系统的本地部署,构建完整的本地AI运行环境。

一、安装前环境准备

首先需要确认系统基础环境满足运行条件。建议使用64位Windows或Linux系统,内存8GB以上,并确保具备基础编译环境与Python运行环境。

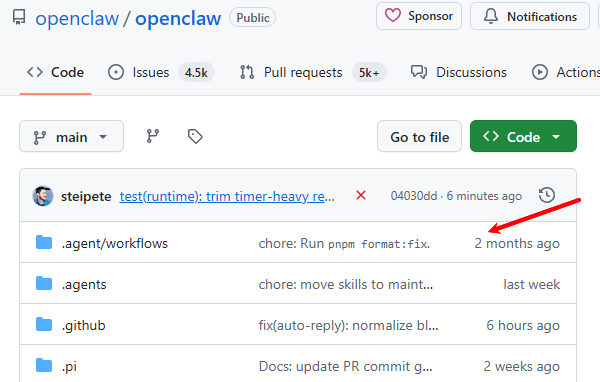

1、获取程序源码

可从开源平台下载最新版本源码,例如在GitHub搜索OpenClaw项目并下载压缩包,或使用git命令克隆仓库。

2、安装运行依赖

常见依赖包括:

Python 3.9及以上版本;

CMake构建工具;

对应平台的编译器(Windows建议MSVC,Linux建议GCC);

3、配置环境变量

将Python与CMake路径加入系统PATH,确保命令行可直接调用。

完成以上步骤后,即可进入核心安装流程。

二、OpenClaw详细安装步骤

步骤1:解压与目录结构检查

将下载的源码解压至目标路径,建议避免中文目录。确认目录中包含核心源文件、配置文件与资源目录。

好评率97%

好评率97%  下载次数:3174954

下载次数:3174954

步骤2:依赖构建

进入项目根目录,执行构建命令:

mkdir build

cd build

cmake ..

cmake --build .

该过程将自动生成可执行文件。若出现编译错误,多与编译器版本或依赖路径有关。

步骤3:配置运行参数

在config文件中设置:

数据路径

缓存目录

日志等级

合理配置可提升运行稳定性与调试效率。

步骤4:启动程序

在build目录执行生成的主程序文件,若终端显示初始化成功信息,即表明安装完成。

三、结合OpenClaw部署助手实现智能对话本地化

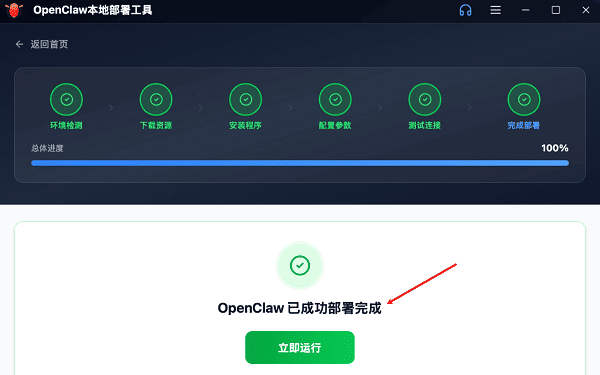

如果不想按照上述这么复杂步骤或者是新手小白不懂得本地部署。那么可以通过专业的本地部署工具“OpenClaw部署助手”,软件能够显著降低模型部署复杂度,点击下载安装,便完成部署,无需复杂的搭建步骤。详细步骤流程如下:

好评率97%

好评率97%  下载次数:3174954

下载次数:3174954 1、点击上方下载按钮安装打开“OpenClaw部署助手”选择“点击立即部署”,然后软件便会进入环境监测、资源下载,自动开始安装部署环境,按照软件提示安装即可;

2、安装目录建议选择默认,整个安装过程一般需要1-3分钟左右,部署过程中建议不要关闭软件窗口,全部安装完成之后,点击“立即运行”;

3、点击【AI模型】界面选择对应的模型(这里以智谱为例),点击“还没账号前往注册”-进入网站首页依次点击网站右侧“控制台-API Key”进入Key的页面选择“添加新的API Key”随机命名一个名称,然后添加。

4、复制“API Key”这串密钥,滑动到软件底部“API Key”选项框粘贴,然后点击“保存模型配置”。

5、切换回“首页”选择右侧“打开聊天”选项,便可以开始你的本地部署工作了。

四、运行验证与性能优化

部署完成后建议进行功能验证:

1、检查程序启动日志是否存在异常;

2、运行示例任务测试响应速度;

3、观察CPU与内存占用情况;

若需优化性能,可考虑:

1、调整线程数量;

2、启用硬件加速;

3、优化缓存策略;

对于长期运行场景,建议配置日志轮转与自动重启机制。

五、常见问题排查

问题1:编译失败

通常由编译器版本不匹配导致,建议更新工具链。

问题2:程序无法启动

重点检查依赖库路径与配置文件格式。

问题3:对话响应缓慢

可降低模型规模或调整推理参数。

通过规范的环境配置与构建流程,OpenClaw能够稳定运行于本地系统之中。而结合OpenClaw部署助手工具,可进一步实现智能对话能力的离线部署,形成从运行框架到AI应用的完整闭环。该方案不仅保障数据安全,也为本地化AI实验与应用开发提供了高可控、高稳定的技术路径。