DeepSeek V4系列推出Pro与Flash双版本后,很多朋友在两者之间犹豫不决。Pro版本侧重深度处理与复杂任务,Flash版本主打快速响应与实时交互。本文通过多维度对比,帮你找到最适合自己的那一款。

一、模型规模与核心能力

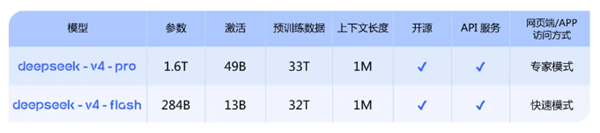

DeepSeek V4-Pro:总参数1.6T,激活参数49B,基于33T token的预训练数据,定位为旗舰级高性能模型,适用于复杂推理、深度科研、Agent智能体等高阶场景。

DeepSeek V4-Flash:总参数284B,激活参数13B,基于32T token的训练数据,主打轻量高效、低成本快速响应,适用于日常办公、内容创作、快速问答等高频刚需场景。

(图源:DeepSeek)

两大版本均标配100万token的超长上下文,可一次性完整处理长篇小说、百万字报告、百页合同、整套行业资料等大型文本,长文本处理能力实现十倍级跃升。

两款模型提供了三种推理模式:快速响应的“非思考模式”、平衡效率与深度的“高思考模式”、以及极致深挖逻辑的“极限思考模式”,满足不同任务对效率与精度的需求。

二、成本与定价

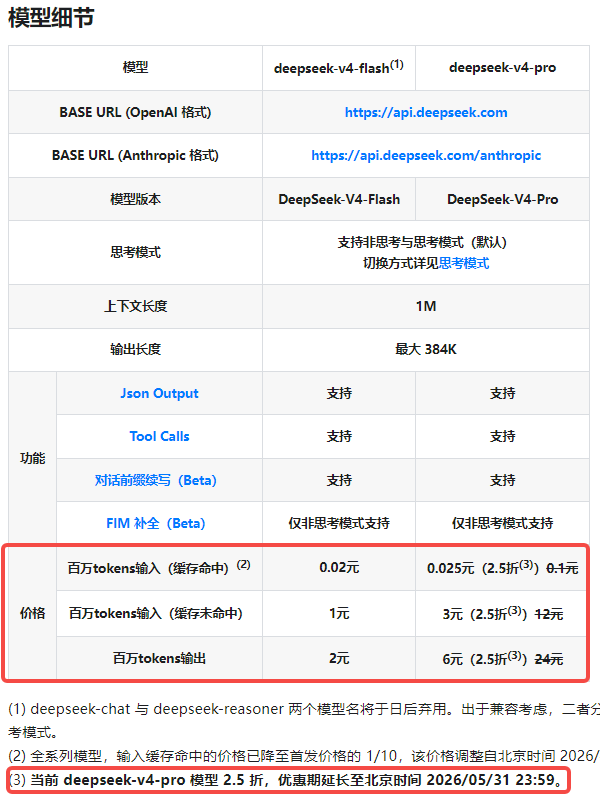

据DeepSeek API 文档显示:

DeepSeek V4-Pro当前享受2.5折优惠,优惠期延长至北京时间2026年5月31日23:59,优惠后,每百万token输出价格为6元。DeepSeek V4-Flash的定价为每百万token输出2元。

(图源:DeepSeek API 文档)

对大多数人和中小企业来说,Flash已经能搞定大多数事情。只有遇到真正复杂的问题,再切到Pro就行——而且Pro现在打折,性价比也很高。

三、组合使用建议

说到这儿,你可能还在纠结。其实最聪明的做法不是二选一,而是两个一起用。

具体怎么用?先用Flash快速筛方向、写初稿,再用Pro深入优化。举个例子:写营销方案时,先让Flash生成10个标题,再选出3个感觉不错的,让Pro扩成完整策略。这样做,又快又好,两全其美。

不过,在自己电脑上同时装Pro和Flash,还要随时切换,对很多朋友来说确实有点门槛——环境配置、依赖安装、API密钥管理……听着就复杂。有个简单办法:可以先装OpenClaw,再接入DeepSeek V4模型。

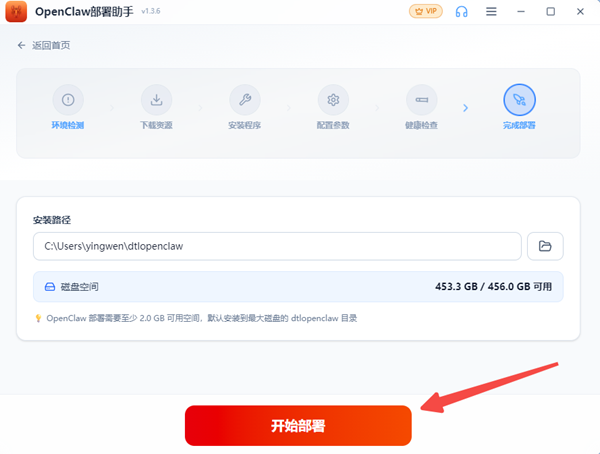

这里推荐OpenClaw部署助手。这个工具能一键安装OpenClaw,自动配好DeepSeek V4模型,不用你手动搞依赖和环境变量,全程图形化操作,小白也能轻松搞定。

操作步骤(跟着做就行):

1、点击下方按钮,下载“OpenClaw部署助手”安装包。

好评率97%

好评率97%  下载次数:3210954

下载次数:3210954 2、打开软件后,点击主界面的“开始部署”按钮。程序会自动安装OpenClaw核心组件并配置Python运行环境。

3、部署过程中如遇到参数配置弹窗,可先选择“确认配置并继续”(后续会提供详细讲解),不影响主流程。

4、当页面提示“已成功部署”,说明OpenClaw已部署完成。

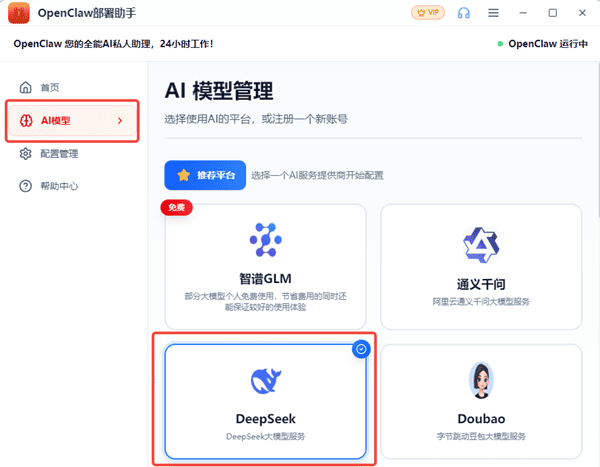

5、打开“AI模型”页面,选择DeepSeek模型并开始配置。

6、点击软件页面提供的链接,前往DeepSeek开放平台注册并登录。

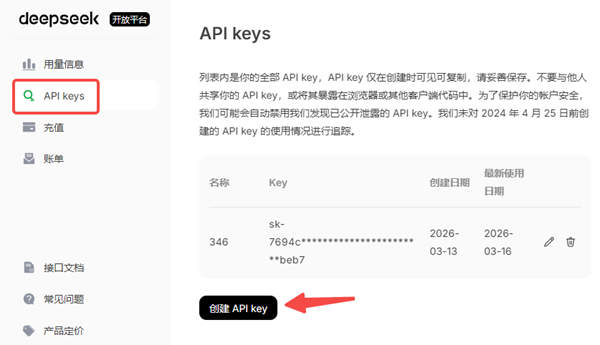

7、找到「API Keys」菜单,点击「创建 API Key」。起一个名称(如openclaw),确认后系统会生成一长串密钥,复制保存。

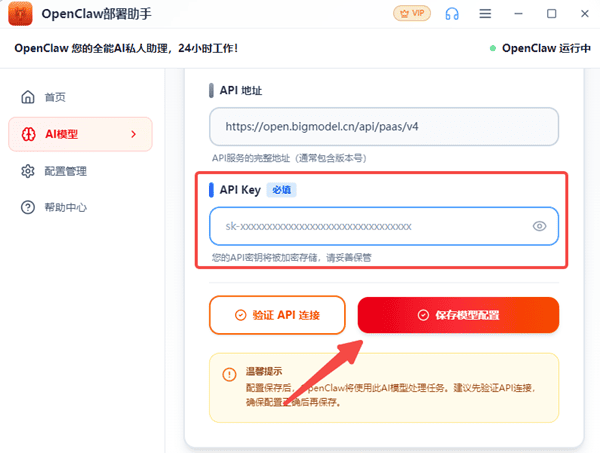

8、返回OpenClaw部署助手,将复制的密钥粘贴到对应输入框中,点击「保存模型配置」。

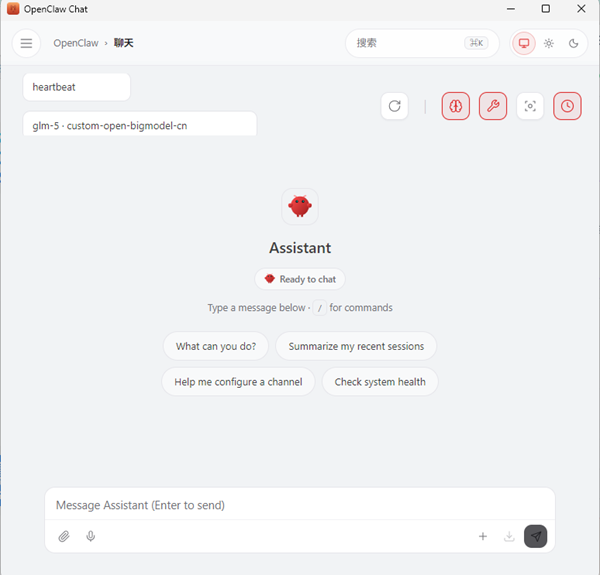

9、点击首页的「打开聊天」——你的专属AI助手正式上线。输入一条测试消息(如“你好,请自我介绍”),如果能正常收到回复,即表示部署成功。

对大多数人来说(查资料、写邮件、日常学东西),Flash体验非常流畅,而且便宜到几乎可以忽略成本;而对专业人士,Pro现在2.5折,是入手的好时机。好了,现在打开OpenClaw部署助手,让DeepSeek V4两个版本同时为你服务吧!